Peux-tu nous présenter ton parcours en quelques mots ? Et notamment préciser ce qui t’a conduit de la composition classique à la musique de jeu vidéo ?

J’ai d’abord étudié la guitare. J’aimais le répertoire classique mais je préférais jouer de la guitare électrique, j’ai donc choisi un cursus en jazz. Ce que j’ai aimé dans cet apprentissage du jazz, c’était que l’improvisation oblige à analyser la musique sous l’angle du pourquoi, alors qu’en interprétation de la musique classique on s’intéresse plutôt au comment. Mais je me rendais compte que je restais surtout dans ma zone de confort pendant mes improvisations, car la situation du concert ne permet pas de se corriger. En composant, j’explorais davantage, car je pouvais corriger après-coup. Mon tempérament me portait donc plus vers la composition, alors que les vrais jazzmen aiment et acceptent l’imprévu dans leur musique.

Ma grande sœur faisait du cinéma d’animation, je faisais la musique de ses films. Tout ça m’a amené vers la musique orchestrale.

Ensuite, j’ai fait des études de composition instrumentale à l’université, principalement pour l’orchestre. Pendant que je faisais ma maîtrise, j’étais assistant pour un compositeur de musique de film qui travaillait sur plusieurs documentaires et de séries télé, Robert-Marcel Lepage. J’ai beaucoup appris sur la musique pour l’image à ce moment-là.

Après avoir eu mon diplôme de deuxième cycle, une compagnie de production de jeu vidéo installée à Montréal, Gameloft, qui à l’époque faisait surtout des jeux mobiles, recrutait des compositeur in house, ce qui est rare car la plupart du temps les compositeurs de musique pour le jeu vidéo sont plutôt des pigistes. J’ai été engagé après une batterie d’interview et d’essais. Nous étions une dizaine de compositeurs avec chacun sa spécialité. Je travaillais plutôt sur la musique orchestrale (jeux inspirés de films, Spider Man, Shreck…), tandis que d’autres étaient plutôt spécialisés rock (jeux de courses de voitures…). J’ai travaillé pour Gameloft pendant plus de 6 ans, j’y ai fait la musique pour plus de 25 jeux.

Mais je l’avais vu d’emblée comme un tremplin, un passage vers quelque chose d’autre. Lorsque j’ai remporté un pitch pour un jeu produit par une autre compagnie (j’avais signé une clause de non-concurrence chez Gameloft) et que plusieurs commandes pour orchestres se sont présentées, j’ai pris la décision de quitter Gameloft. Maintenant, je suis compositeur pigiste, avec un agent, et j’écris pour des orchestres. J’enseigne une journée par semaine la musique pour jeu vidéo, la composition et l’orchestration à l’Université de Sherbrooke, dans un programme de premier cycle universitaire en Composition de musique à l’image.

Quelles techniques as-tu utilisées pour adapter ta musique aux contraintes du jeu vidéo (probabilités, boucles, chaînes de Markov…) ? As-tu travaillé avec un programmeur ou une équipe de programmeurs, et comment s’est passé ce travail ?

Chez Gameloft, je ne faisais que de la composition, mais je choisissais les systèmes de musique interactive en collaboration avec l’équipe chargée de l’intégration et de la programmation. Ces années m’ont beaucoup appris sur la manière dont les programmeurs utilisent la musique produite par un compositeur pour un jeu. Les techniques utilisées dépendent beaucoup de l’évolution des devices. Quand j’ai commencé, c’était l’arrivée de l’iPod touch. Avant, on composait principalement des fichiers MIDI, qui jouaient la banque de sons du téléphone. Les sons pouvaient donc varier considérablement d’un modèle de téléphone à l’autre, avec les problèmes de mixage que cela suppose. Il y avait des techniciens du son dont le travail était d’adapter les musiques aux différents devices. L’iPod touch, lui, pouvait jouer du wav. Mais la puissance en CPU était limitée. Toutes ces contraintes techniques étaient à garder en tête quand on composait la musique.

Au début, l’interactivité était présente mais rudimentaire : boucles, musique de victoire, musique de défaite. L’évolution des modèles de smartphone et des consoles a ouvert la voie à plus de possibilités. Je n’ai jamais suivi de cours de composition de musique pour jeu vidéo, mais j’ai découvert par intuition plusieurs techniques :

-

- Boucles pouvant être interrompues à n’importe quel moment par un fichier de conclusion ou de transition.

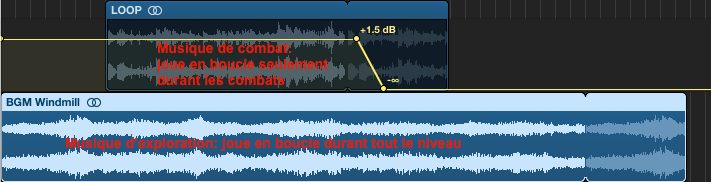

- Superposition de boucles de différentes longueurs : par exemple une musique ambiante, sans rythme, destinée à accompagner la phase d’exploration, et quand un combat survient, une musique percussive introduisant une nouvelle boucle, sans hauteur, donc compatible avec la musique ambiante sans conflit d’harmonie ni de tempo. Il s’agit en quelque sorte de séparer les paramètres musicaux en plusieurs trames pour éviter les zones de conflit. Cette technique simple permet de donner une perception de richesse à l’auditeur alors que les éléments sont limités.

-

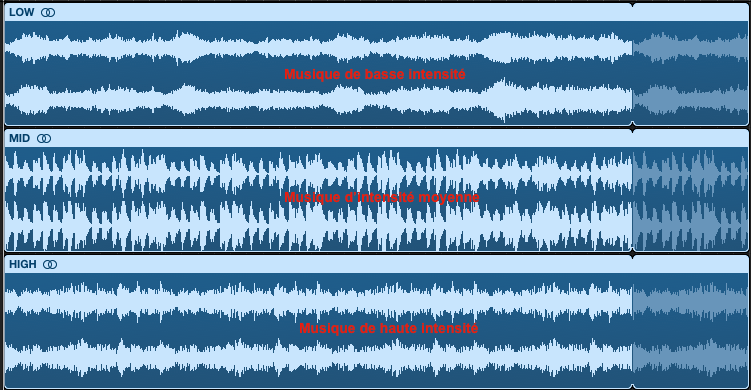

- Superposition de boucles synchronisées : il s’agit d’empiler différentes trames de même longueur, en gardant le volume de certaines boucles à zéro, puis de jouer sur le volume de chaque boucle pour faire évoluer la musique. Produisant moins de contraste que la technique précédente, elle est plus adaptée aux jeux où les niveaux d’action et d’exploration alternent assez rapidement, pour éviter l’effet de « stop and go » permanent.

-

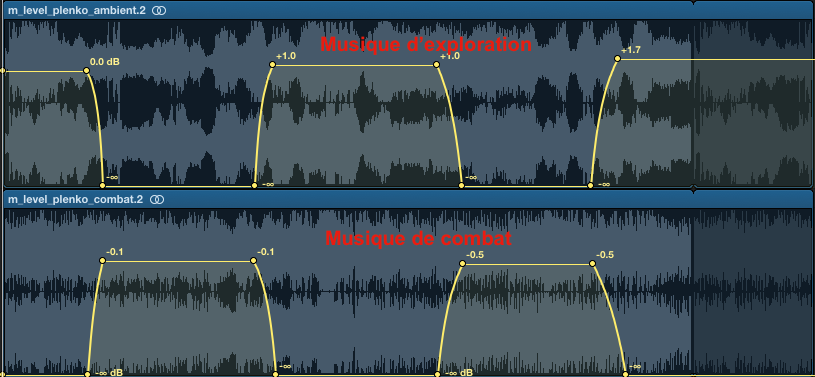

- Boucles en fondu enchaîné : il s’agit de composer des boucles en métamorphoses progressives, en jouant sur les modes de jeu, les changements d’orchestration. C’est une manière plus naturelle et plus organique de gérer les transitions, qui se rapproche davantage de la musique pour le cinéma. (Exemple d’une musique d’exploration et la version “combat” de la même musique)

-

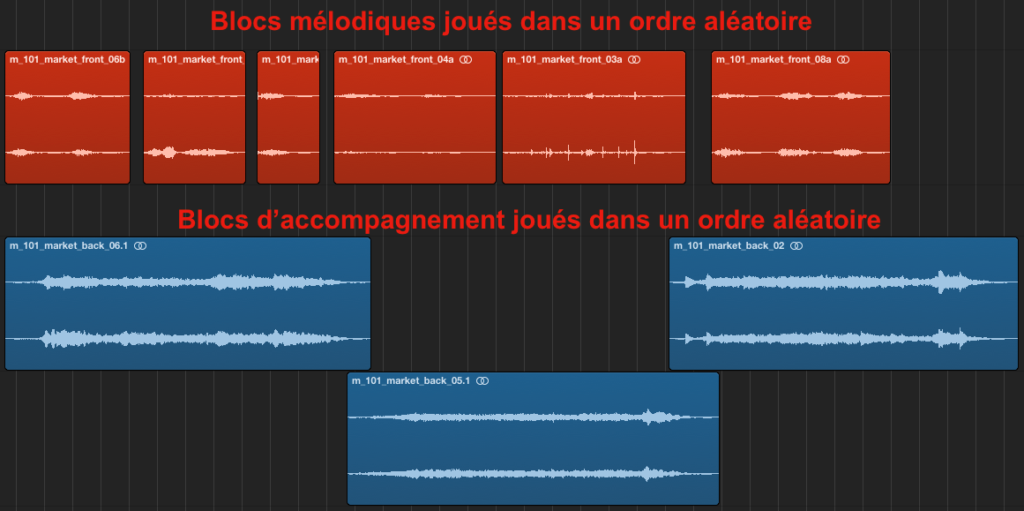

- « Re-séquencage » : plusieurs blocs de musique sont joués dans un ordre aléatoire, parfois séparés par des silences de durée aléatoire, parfois enchaînés par un procédé d’overlapping. Si on est dans une esthétique tonale, il faut s’assurer que les boucles puissent s’enchaîner aux points de synchronisation pré-définis, pour éviter d’attirer l’attention là il ne faudrait pas. Une façon simple est de commencer sur le degré I et de finir sur V, mais c’est vite ennuyeux. On peut introduire des cadences rompues, ou créer des fausses modulations. Faire de la musique modale est aussi une façon de s’en sortir, mais ça ne s’adapte pas à l’esthétique de tous les jeux. (Exemple de re-séquençage)

-

- « Re-séquencage superposé » : c’est la technique la plus complexe que j’ai utilisée en musique interactive. On peut avoir par exemple deux couches de re-séquencage, une pour des accompagnements en sons ambiants, joués en tuilages, et une autre avec des extraits plus mélodiques et pulsés. Cela permet de créer des variantes par la combinatoire, par exemple en changeant la couleur tonale des mélodies. C’est comme se baigner dans une rivière : c’est toujours la même rivière, mais jamais la même eau. C’est beaucoup plus immersif pour le joueur, et très adapté aux jeux avec beaucoup d’heures de gameplay. (Exemples de re-séquençage superposé)

Quels sont les défis auxquels se confronte le compositeur de musique de jeu vidéo ?

Il y en a principalement deux : l’interactivité et le renouvellement. Il s’agit de donner au joueur l’illusion que la musique est composée pour sa performance, sans qu’il ne se rende compte des ficelles. C’est une quête infinie car la technologie évolue sans cesse et les possibilités sont de plus en plus grandes. Avoir un renouvellement constant de la musique dans un jeu est également important car on peut rester dans le même environnement pendant une ou deux heures.

L’un des défis actuels, c’est de mieux prendre en compte l’anticipation d’une action : au cinéma, il est facile de calibrer la montée de la tension lorsqu’un personnage s’approche d’une porte, par exemple. En jeu vidéo, c’est plus complexe puisqu’on ne sait pas combien de temps le joueur prendra pour se rendre à la porte.

Y a-t-il eu un impact esthétique sur ton écriture ? Certaines des techniques développées pour le jeu vidéo se retrouvent-elles dans tes pièces de musique de concert ?

Dans le cas du jeu vidéo, c’est le jeu qui guide le système de composition que je vais utiliser, dans le cadre d’un travail d’équipe avec de fortes limitations techniques, des contraintes d’échéancier, de budget… Il ne faut pas chercher à faire quelque chose de complexe pour rien.

Pour moi, la musique de concert représente une manière de me libérer de ces contraintes formelles. Si je peux déterminer la meilleure option par moi-même, je préfère le faire. Pourquoi laisser le choix aux interprètes alors que j’ai l’option de pouvoir choisir pour eux ?

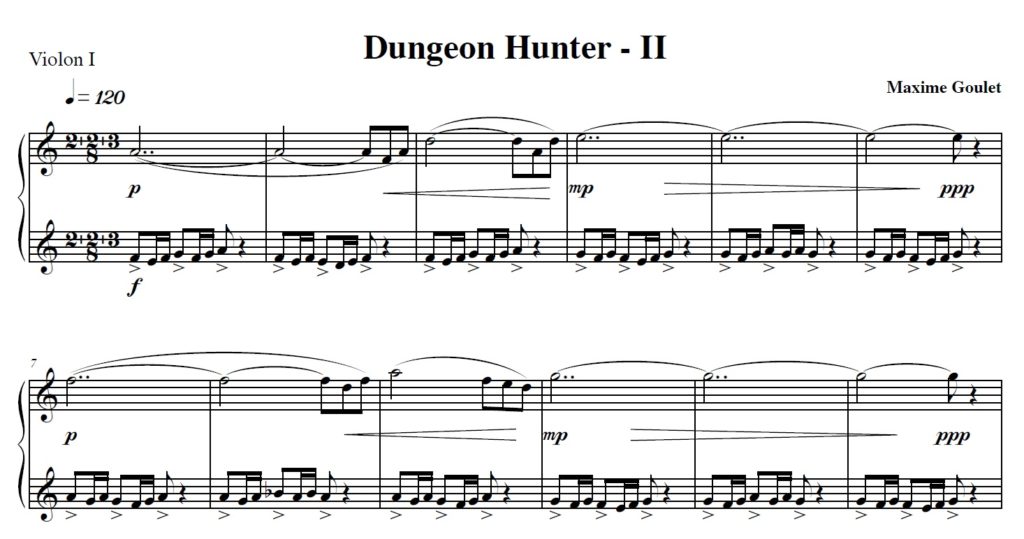

Mais il y a des expériences hybrides, par exemple lorsque nous avons fait jouer par des instrumentistes en live la musique de Dungeon hunter 2. Les musiciens d’orchestre suivaient de façon interactive la performance d’un joueur. La partition de chaque instrumentiste était écrite sur deux portées, une ambiante, l’autre de combat, et, à la manière de boucles en fondu enchaîné, le musicien pouvait passer à chaque instant de l’une à l’autre portée en fonction du jeu.

Il y a également le cas de Trois Jeux pour orchestre et ballon de plage. Un ballon de plage géant est donné à la foule, dont on peut suivre le parcours sur l’écran grâce à un tracker, et le public doit notamment attraper des étoiles avec le ballon. Plusieurs techniques de jeu vidéo se retrouvent dans la partition d’orchestre : boucles superposées, effets sonores dédiés à certains instruments…

Il y a également le cas de Trois Jeux pour orchestre et ballon de plage. Un ballon de plage géant est donné à la foule, dont on peut suivre le parcours sur l’écran grâce à un tracker, et le public doit notamment attraper des étoiles avec le ballon. Plusieurs techniques de jeu vidéo se retrouvent dans la partition d’orchestre : boucles superposées, effets sonores dédiés à certains instruments…

Dans mon opéra Bungalopolis, qui est basé sur un ensemble de 15 courtes bande dessinées de deux pages, l’un des épisodes est une « BD dont vous êtes le héros ». Un peu comme si on avait : « si tu veux combattre le dragon, va à la case 11, si tu veux partir en courant, va à la case 14 ». Nous étions un collectif de 5 compositeur pour cet opéra, et j’ai réparti la composition de la musique des différentes cases aux autres compositeurs, sans qu’ils sachent ce qui allait venir avant ou après. La forme de l’œuvre était donc déterminée chaque soir par le public : parfois certaines cases n’étaient pas jouées du tout, d’autres jouées plusieurs fois. L’œuvre était composée sous forme d’arborescence.

Ton utilisation des outils d’informatique musicale a-t-elle été transformée par cette expérience ? Existe-t-il des logiciels spécifiques ?

Je travaille généralement avec un séquenceur MIDI car les banques de sons sont meilleures qu’avec un logiciel d’édition de partition comme Finale. Puis, en collaboration avec mon assistant, j’établis la partition à partir de mon travail dans le séquenceur.

Les compagnies de jeu vidéo intègrent généralement elles-même la musique dans leurs jeux. Certains compositeurs font eux-même l’intégration dans le sound engine (par exemple dans Wwise). Il y a aussi des compagnies audio, à Montréal, qui proposent à la fois de fournir la musique, les effets sonores et l’intégration sonore, clef en main.

Gameloft utilisait son propre sound engine, un équivalent de Wwise. Ce logiciel proposait beaucoup de moyens pour générer de l’aléatoire dans la partie des effets sonores (par exemple les chants d’oiseaux), et j’ai voulu utiliser ce module de la même manière avec des fichiers sonores de musique. C’est ce qui m’a amené à cette idées de faire des superpositions de couches musicales déclenchées aléatoirement, pour le jeu Dungeon Hunter 4. Lorsque la compagnie sortait des extension packs, cela me permettait aussi de récupérer des avant-plans et arrière-plans de la première version du jeu, et de les recombiner, plutôt que de réutiliser telle quelle une ancienne musique.

On a parfois l’impression que “l’adaptive music” passe nécessairement par de la musique MIDI, des synthétiseurs et des samples, et par un sacrifice de la richesse d’une interprétation par des instrumentistes. Qu’en est-il dans ton travail ? Comment trouver le juste équilibre ?

En parlant avec l’équipe, on détermine si nous allons engager de vrais musiciens ou pas, selon le budget et selon le niveau d’interactivité souhaité. Avec un niveau d’interactivité élevé, il faut une piste par instrument, donc une phase d’enregistrement longue. Et contrairement au cinéma, où le musicien travaille en post-production, en jeu vidéo la musique est développée en même temps que le jeu. Parfois le jeu change à 180° en cours de route, et si la musique est déjà enregistrée, elle n’est plus utilisable. Si on n’est pas certain de la direction que va prendre le jeu, le MIDI est donc une solution plus sûre, car plus flexible.

Il faut aussi prendre en compte l’esthétique du jeu, en somme plein de facteurs autres que des considérations musicale.

Très souvent, on mixe des vrais instruments et des samples. Pour Brothers in arms 3, la musique d’interface (thème d’ouverture, victoire, échec) a été enregistrée par un orchestre, et le reste en MIDI, sauf certaines parties de trompette enregistrée en studio. Il s’agit de maximiser les ressources, surtout quand le jeu se déroule sur un champ de bataille où le bruit des coups de feu va finalement couvrir la musique la plupart du temps…

Les formes ouvertes et modulaires en matière de musique symphonique se trouvent plutôt dans la musique d’avant-garde : quelles ont été tes sources d’inspiration personnelles ?

Mes goûts musicaux sont très hétéroclites, mais je citerais en premier Prokofiev. C’est quand j’écoute sa musique que je me dis le plus souvent : « J’aurais voulu écrire cette pièce ». Mais il y a aussi John Adams, Giacinto Scelsi, Gyorgy Ligeti, Steve Reich, et aussi les sommets de la musique orchestrale du début du XXe siècle : Stravinsky, Ravel, Chostakovitch. J’aime également Radiohead, Björk… En ce moment j’écoute beaucoup Too Many Zooz, un trio de free jazz inspiré par l’EDM. En réalité, chaque projet me conduit à chercher de nouvelles sources d’inspiration. Pour Par un soir d’Halloween, j’ai beaucoup écouté Danny Elfman, John Williams, Bernard Herrmann…

As-tu d’autres projets liés au monde du jeu vidéo ou de la création musicale générative (environnements sonores, installations…), et si oui de quelle nature ?

En ce moment, j’écris un concerto pour piano, intitulé Echec et mat, qui est une mise en musique de la partie entre Garry Kasparov et Deep Blue, la première fois qu’un ordinateur battait un champion d’échec dans un tournoi. Des thèmes musicaux sont associés à chaque pièce du jeu ; l’orchestre représente les blancs, le piano les noirs. La partie d’échec sera projetée sur un écran, tous les mouvements de cette partie historique préprogrammés. Il fallait des thèmes forts et bien identifiables, reconnaissables même lorsqu’on n’en entend que trois notes. Le cavalier a une musique inspirée du western, des musiques de Sergio Leone. Le roi, plus Lisztien, plus virtuose ; la Reine, plus lyrique et dramatique.

Il y a en tout une soixantaine de déplacements de pièces dans la partie entre Kasparov et Deep Blue, c’est donc un vrai défi formel de soutenir l’intérêt avec cette technique pendant toute la durée du concerto. L’œuvre sera crée le 21 septembre 2018, à Houston, par le River Oaks Chamber Orchestra.

(Propos recueillis en février 2018)